El pasado 7 de octubre, Hamás lanzó un cruento ataque sobre varias regiones de Israel cercanas a la frontera con Palestina, lo que detonó una contraofensiva israelí que ha provocado miles de muertos en la Franja de Gaza.

Este conflicto estalló casi veinte meses después de la invasión rusa a Ucrania y que dio inicio a una guerra que se continúa disputando.

Puede parecer que ambos conflictos no tienen relación entre sí; sin embargo, la narrativa de desinformación que los rodea es bastante similar. De hecho, en las últimas semanas han circulado videos falsos que intentan vincular a Rusia y Ucrania con Palestina y Hamás, respectivamente.

Por ejemplo, vía Telegram comenzó a circular un video que, utilizando el formato de la BBC, aseguraba que Ucrania le vendió armas a los militantes de Hamás. Supuestamente, esta conclusión habría sido alcanzada por los periodistas de Bellingcat, pero fue el mismo equipo el que desmintió en sus redes la veracidad del clip.

Pero, más allá de las conexiones directas a la hora de desinformar, existen similitudes en las estrategias y narrativas que se han difundido. En este artículo abordaremos algunas de ellas en detalle.

“Es un conflicto fabricado, las imágenes no son reales”

Como explicamos en un artículo anterior, usuarios en redes sociales han puesto en duda la veracidad de los videos e imágenes viralizadas. Esto se ha hecho, principalmente, usando clips de los detrás de escenas de películas o cortometrajes en los que se aprecia una cámara grabando a las personas que aparecen en el cuadro.

En el caso de la guerra en Ucrania, circula un reporte de prensa en el que se observa que uno de los “cadáveres” se mueve detrás del periodista. Este clip, que se ha compartido nuevamente a finales de octubre, circula desde inicios de la guerra. En este caso, se copia el formato de una nota que fue emitida por NBC el 24 de febrero de 2022 para mostrar un video que fue grabado 20 días antes.

Por otro lado, recientemente se ha compartido en redes sociales un video que da por hecho la misma premisa. De hecho, uno de los usuarios que lo publicó señaló que se trata de la “misma táctica que hemos visto durante el conflicto de Ucrania”. En este caso, se muestra a un niño tendido en el suelo mientras es grabado por una cámara profesional.

Pero, a diferencia de lo que aseguran las publicaciones, no es un video reciente. El mismo clip circula en TikTok desde abril de 2022 y corresponde al detrás de escena de un cortometraje que fue publicado en el mismo mes.

Aprovechamiento de la barrera idiomática para inventar subtítulos

Desde el principio de la guerra en Ucrania, la diferencia idiomática ha sido un factor a considerar a la hora de replicar información. Como los reportes originales están en un idioma que no es de uso universal, usuarios se han aprovechado de esto para crear sus propias noticias a partir de videos reales.

Por ejemplo, en marzo de 2022 comenzó a circular un clip en el que Volodymyr Zelenskyy dice que “Estados Unidos tendrá que enviar a sus hijos e hijas como nosotros estamos enviando a nuestros hijos e hijas a la guerra”.

Sin embargo, la frase fue sacada de contexto, ya que el mandatario se refería a que Estados Unidos tendrá que ingresar al conflicto si es que miembros de la OTAN se involucran. Al compartir un clip corto, se pierde el sentido de lo que realmente fue dicho por Zelenskyy.

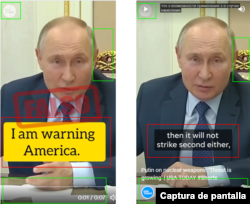

En la otra vereda, recientemente circuló un video en el que Vladimir Putin, supuestamente, advierte que apoyará a Palestina si es que Estados Unidos decide apoyar a Israel. En este caso, se tomó un video de diciembre de 2022 que fue publicado por USA Today y se incluyó una caja amarilla de texto con una traducción deficiente, como se ve a continuación:

Esta estrategia también se usó para subtitular un video, originalmente en árabe, en el que aparece el Primer Ministro de Israel, Benjamin Netanyahu. Según los subtítulos, el PM habría anunciado que bombardeará Gaza y pide perdón a los israelíes que “se verán afectados”. El clip dura 38 segundos y fue extraído de una transmisión oficial. Sin embargo, en el registro real se refiere al ataque de Hamás y asegura que velará para que “no pase otra vez”.

Descontextualización de la protesta

Uno de los tipos más comunes de desinformación es la descontextualización de imágenes o videos. En caso de este tipo de conflictos, es común ver videos de explosiones que, supuestamente, habrían ocurrido en los sitios de guerra, pero que, en realidad, fueron grabados años antes o en lugares completamente diferentes.

Desde el 25 de septiembre, circula en redes sociales un video en el que se asegura que en Montreal ocurrió una protesta en contra del anuncio del paquete de ayuda de Canadá a Ucrania. Si bien las imágenes son reales, lo cierto es que esa protesta estaba planificada desde, al menos, agosto de este año. Además, fue convocada por los trabajadores públicos y para obtener mejores condiciones laborales.

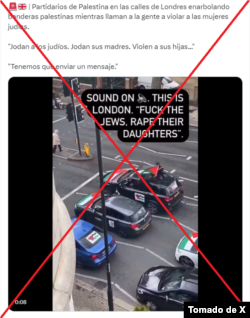

Un ejemplo similar, pero extrapolado al conflicto entre Israel y Palestina, circula en redes sociales desde finales de octubre. En este video, aparece un grupo de partidarios de Palestina gritando mensajes antisemitas por las calles de Londres.

Sin embargo, la búsqueda inversa con uno de los fotogramas condujo a una serie de videos de 2021. De acuerdo con los reportes de prensa de la época, cuatro personas relacionadas al incidente del video fueron arrestadas.

El uso de secuencias de videojuegos para desinformar

En un artículo anterior explicamos cómo es que se han utilizado los videojuegos para desinformar. El material más replicado ha sido extraído del videojuego de simulación “ArmA 3”, un shooter en tercera persona caracterizado por sus gráficos hiperrealistas.

Ejemplos de estas desinformaciones sobran. Por ejemplo, en marzo de 2022 varios usuarios publicaron un video en el que se observa a un avión eludiendo los disparos de fuerzas militares. La descripción exacta variaba según el apoyo del usuario: mientras unos decían que se trataba del “fantasma de Kiev”, otros aseguraron que era un avión ruso escapando de las defensas ucranianas.

No obstante, la secuencia de seis minutos fue extraída en su totalidad de un video de ocho minutos en YouTube. Esto pese a que el usuario que subió la secuencia a esta plataforma señaló en la descripción del video que se trata de una simulación obtenida del ArmA 3.

Respecto a Israel y Palestina, el mismo 7 de octubre comenzó a circular un video en el que, supuestamente, "cazas de Hamás" derribaban un helicóptero de guerra israelí. El video incluye sonidos de lanzamiento de misiles y diálogos entre militares, así como una secuencia fluida de los acontecimientos. Sin embargo, el video fue obtenido del videojuego ya mencionado.

Cabe recordar que es en tiempos de crisis y sobrecarga de información que las desinformaciones proliferan. Las narrativas mencionadas son sólo algunas de las formas en que se puede difundir información errónea, por lo que es necesario ser cuidadoso con la información que se comparte.

[Este artículo es parte de la alianza periodística de verificación entre Mala Espina, de Chile, y Voz de América. Para saber más sobre la metodología utilizada en los chequeos, puedes ingresar a este enlace.]

¡Conéctate con la Voz de América! Suscríbete a nuestros canales de YouTube, WhatsApp y al newsletter. Activa las notificaciones y síguenos en Facebook, X e Instagram.