El conflicto armado entre Rusia y Ucrania, así como otros eventos políticos importantes del último tiempo, no ha estado exento del uso de las tecnologías para desinformar. En VOA Verifica hemos abordado cómo los agentes desinformadores recurren a la fabricación de grafitis, suplantación de medios de comunicación y al uso de inteligencia artificial.

La Inteligencia Artificial (IA), que avanza a pasos agigantados, no solo se ha utilizado para crear imágenes graciosas, como las del supuesto paseo de Vladimir Putin y Kim Jong Un, sino que también es posible realizar montajes audiovisuales con el rostro y voz de una persona. A esto último se le conoce como deepfake y se utiliza, en contextos de desinformación, para perjudicar la imagen de alguna figura pública.

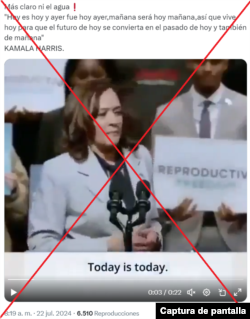

Por ejemplo, luego de que Joe Biden comunicara su retiro de la carrera por la presidencia de Estados Unidos, usuarios viralizaron un clip en el que se ve (y escucha) a Kamala Harris decir una frase sin sentido. Según las publicaciones, la vicepresidenta habría dicho que “hoy es hoy y ayer es hoy ayer. El mañana será hoy mañana, así que vive hoy para que el futuro de hoy sea como el pasado de hoy, como lo es mañana”.

El video en cuestión resultó ser falso: tanto las imágenes como el audio de la intervención de Harris en la Universidad Howard sobre el aborto fueron modificados para crear la secuencia viral.

Esta es una estrategia que no es novedosa y que ha estado presente desde el inicio del conflicto en Ucrania. En este artículo repasaremos algunos de los ejemplos más virales que han circulado hasta fines de julio de 2024.

Los deepfakes que circulan relacionados a la guerra en Ucrania

Tres semanas después del inicio de la guerra, el 16 de marzo de 2022, circularon un clip de Zelenskyy y otro de Putin en el cual ambos declaraban el fin de la guerra. En los videos, los mandatarios solicitan la retirada de sus tropas del frente de batalla.

Sin embargo, ambos videos eran falsos. En el caso de Zelenskyy, la edición resulta evidente: la cabeza del mandatario fue editada sobre una imagen fija y el color de la piel entre el cuello y el rostro no es el mismo.

El video de Putin, por otro lado, fue creado por un ucraniano con el objetivo de “ridiculizar” el video de Zelenskyy y, en ese caso, la manipulación se observa en la discrepancia entre el movimiento de la boca del mandatario ruso y el audio. Al respecto, el usuario que creó el clip indicó que “este es un trabajo de calidad, no como la porquería que usaron contra Zelenskyy”.

Desde el inicio de la invasión rusa, Zelenskyy ha sido el protagonista de varios deepfakes, como este video falso en el que habría consumido drogas y otro en el cual habría dicho que necesita dinero para “un nuevo yate”.

Uno de los temas más recurrentes en estos videos es el “verlo bailando” distintas canciones. Este tipo de registros suele viralizarse luego de la aprobación de algún paquete de ayuda a Ucrania, ya que usuarios indican que estaría “celebrando”.

En VOA Verifica hemos desmentido la veracidad de dos videos de este tipo. Uno de los últimos que circula en redes sociales muestra al mandatario bailando en una fiesta.

No obstante, este clip, y una versión en la cual Zelenskyy lleva un traje verde, fueron creados por un usuario de TikTok que se dedica a realizar este tipo de contenido. En su perfil se encuentran varios videos del presidente de Ucrania, pero también de Joe Biden, Olaf Scholz y Emmanuel Macron, entre otras figuras públicas.

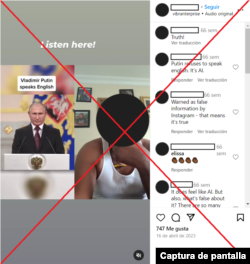

En el caso de Vladimir Putin, se viralizó un clip en el cual dice: “Estados Unidos, me culpan de interferir en su democracia, pero no tengo por qué hacerlo. Lo hacen ustedes mismos” y que “no saben en quién confiar, están divididos. Hay influencias que podemos mover, pero no tenemos que hacerlo. Ustedes las mueven por nosotros”.

Sin embargo, el video fue creado por la organización RepresentUs como parte de una campaña publicitaria destinada a mostrar la fragilidad de la democracia. El clip comenzó a circular a fines de septiembre de 2020, antes de las elecciones de ese año. La organización también difundió un deepfake de Kim Jong Un.

Otro ejemplo es un clip que circuló en junio de 2023 en el cual Putin habría anunciado la imposición de la ley marcial en el territorio. Sin embargo, el video fue declarado como un deepfake por el Kremlin y la Compañía de Radio y Televisión Interestatal.

Además de los mandatarios de los países involucrados directamente en el conflicto, también circulan deepfakes de otras figuras públicas, como Joe Biden. En redes, usuarios viralizaron un clip en el que el Presidente de Estados Unidos anuncia que invocará la Ley de Servicio Selectivo para que jóvenes estadounidenses se enfrenten a Rusia e Irán, el cual desmentimos en este artículo:

Otros ejemplos son el video en el que la jefa de prensa de la Casa Blanca dice que Ucrania y Estados Unidos pelearon juntos contra Rusia en la Segunda Guerra Mundial, el registro en el que Matthew Miller, portavoz del Departamento de Estado, “intentó justificar el ataque ucraniano a Belgorod” y un reporte de France 24 sobre el supuesto intento de asesinato de Macron. También se ha viralizado un clip en el que el exsecretario del Consejo de Seguridad Nacional aseguró que Ucrania fue responsable del tiroteo en Moscú en marzo de este año y otro en el que el ex Comandante en Jefe de las Fuerzas Armadas de Ucrania anuncia un golpe de Estado.

Por otra parte, para asegurar que Olena Zelenska realizó la compra de un Bugatti de más de 4 millones de euros se difundió un deepfake de un supuesto empleado de la sucursal de París. Esta desinformación la abordamos en detalle en este artículo:

Pero no solo han circulado videos deepfakes, sino que también de audio. Por ejemplo, en diciembre de 2023 se viralizó una supuesta “llamada filtrada” entre Volodymyr Zelenskyy y su esposa, Olena Zelenska. En el audio, ambos hablan de Joe Biden y Antony Blinken, calificándolos de “hipócritas” y “payasos”. Sin embargo, el audio fue creado con ayuda de la inteligencia artificial, como explicamos en este verificado:

Un caso similar fue el audio atribuido a la madre de Alexei Navalny en el cual realizaría graves acusaciones en contra de la esposa de su difunto hijo; no obstante, el material también fue realizado con ayuda de una IA.

¿No sabes cómo puedes identificar un deepfake? En este video te entregamos algunos consejos para poder reconocerlos:

En artículos anteriores hemos explicado cómo puedes verificar imágenes y videos para evitar compartir contenido que desinforme a otros usuarios. Sin embargo, recuerda que puedes escribirnos si ves alguna publicación que te cause dudas.

[Este artículo es parte de la alianza periodística de verificación entre Mala Espina, de Chile, y Voz de América. Para saber más sobre la metodología utilizada en los chequeos, puedes ingresar a este enlace.]

¡Conéctate con la Voz de América! Suscríbete a nuestros canales de YouTube, WhatsApp y al newsletter. Activa las notificaciones y síguenos en Facebook, X e Instagram.

![Un hombre con una bandera ucraniana visita una avenida donde se exhiben vehículos militares rusos destruidos antes del Día de la Independencia en Kiev, Ucrania, el lunes 21 de agosto de 2023. [Foto: Archivo/AP]](https://gdb.voanews.com/380f71b4-50f5-4559-acf3-37d315f43e13_w250_r1_s.jpg)

Foro